Ao navegar nas redes sociais, muitas pessoas se questionam “O que é real ou falso?”, atualmente, as redes sociais trazem um grande número de informações falsas aos navegadores. As imagens, vídeos e áudios que circulam nas redes podem ser facilmente manipuladas pela Inteligência Artificial (IA); bastam poucos cliques e um algoritmo treinado. Confira abaixo o impacto causado pelos conteúdos falsos e como isso pode afetar você.

O que é IA?

A IA é um ramo da ciência da computação que desenvolve sistemas e programas capazes de realizar tarefas que normalmente exigem inteligência humana, como aprender, resolver problemas, reconhecer padrões, compreender linguagem natural e tomar decisões. A IA utiliza algoritmos, grandes volumes de dados e modelos matemáticos para simular capacidades cognitivas humanas.

O salto dos conteúdos falsos: de ameaça periférica a fenômeno nacional

Entre os últimos dois anos, o volume de conteúdos falsos gerados por IA cresceu 308%, conforme o Panorama da Desinformação no Brasil do Observatório Lupa. O estudo analisou 617 conteúdos verificados em 2025, contra 839 em 2024, e revelou o aumento significativo de manipulações digitais. Enquanto em 2024 apenas 4,6% das desinformações verificadas (39 casos) tinham origem em IA, em 2025 esse percentual subiu para quase 25% (159 casos), mostrando o crescimento dessa ameaça nas plataformas digitais para 2026.

Quais são os maiores riscos?

Confira quais são os maiores riscos que esta tecnologia pode causar:

- Disseminação de notícias falsas – Criação e amplificação de informações enganosas ou falsas que manipulam a opinião pública;

- Golpes e fraudes virtuais – Uso de IA para criar perfis falsos, mensagens e conteúdos convincentes que aplicam golpes financeiros e phishing;

- Manipulação digital – Vídeos, áudios e imagens falsificados realistas que podem prejudicar a reputação de pessoas ou influenciar eventos;

- Impersonação e roubo de identidade – Abusadores se passando por outras pessoas para enganar, intimidar ou extorquir vítimas.

- Manipulação política e inflamação de conflitos – Criação e disseminação de conteúdos para instigar revoltas, polarização e manipular eleições.

- Automatização de discursos de ódio e assédio – A IA amplifica discursos de ódio, bullying e assédio online.

- Violação de privacidade e coleta de dados – Uso indevido de dados pessoais para monitoramento, manipulação e ataques direcionados a usuários.

Impacto no comportamento, decisões e confiança

A desinformação gerada por IA impacta a forma como as pessoas se informam, avaliam lideranças e tomam decisões diárias. Essa manipulação reduz a confiança, facilita fraudes e dificulta distinguir o que é verdadeiro. Plataformas enfrentam pressão para criar ferramentas contra a IA, mas especialistas ressaltam que soluções técnicas sozinhas não bastam, pois o problema está ligado ao comportamento humano e a interesses políticos.

Rostos e vozes que confundem

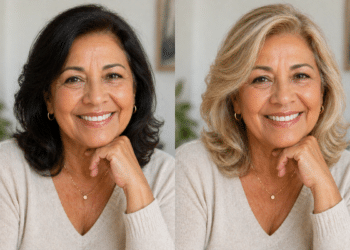

Deepfake: é uma técnica de inteligência artificial que cria vídeos, áudios ou imagens falsos, porém muito realistas, ao substituir rostos e vozes de pessoas em cenas onde elas nunca estiveram. Essa técnica só vem crescendo, tornando a detecção manual cada vez mais difícil. O uso de nomes reconhecidos amplia o alcance da manipulação. Em muitos casos, vídeos falsos viralizam e, mesmo após serem desmentidos, continuam a circular, o que agrava o cenário de desinformação.

Mudança estrutural: o papel da IA na manipulação política

Antes, o uso da inteligência artificial estava mais centrado na criação de golpes digitais e falsos depoimentos de celebridades. Recentemente, essa tecnologia tem se voltado principalmente para o campo político, sendo usada para produzir conteúdos manipulados que buscam influenciar o debate público, atacar reputações de líderes e difundir desinformação ideológica.

O efeito viral: das bolhas do WhatsApp para novos territórios digitais

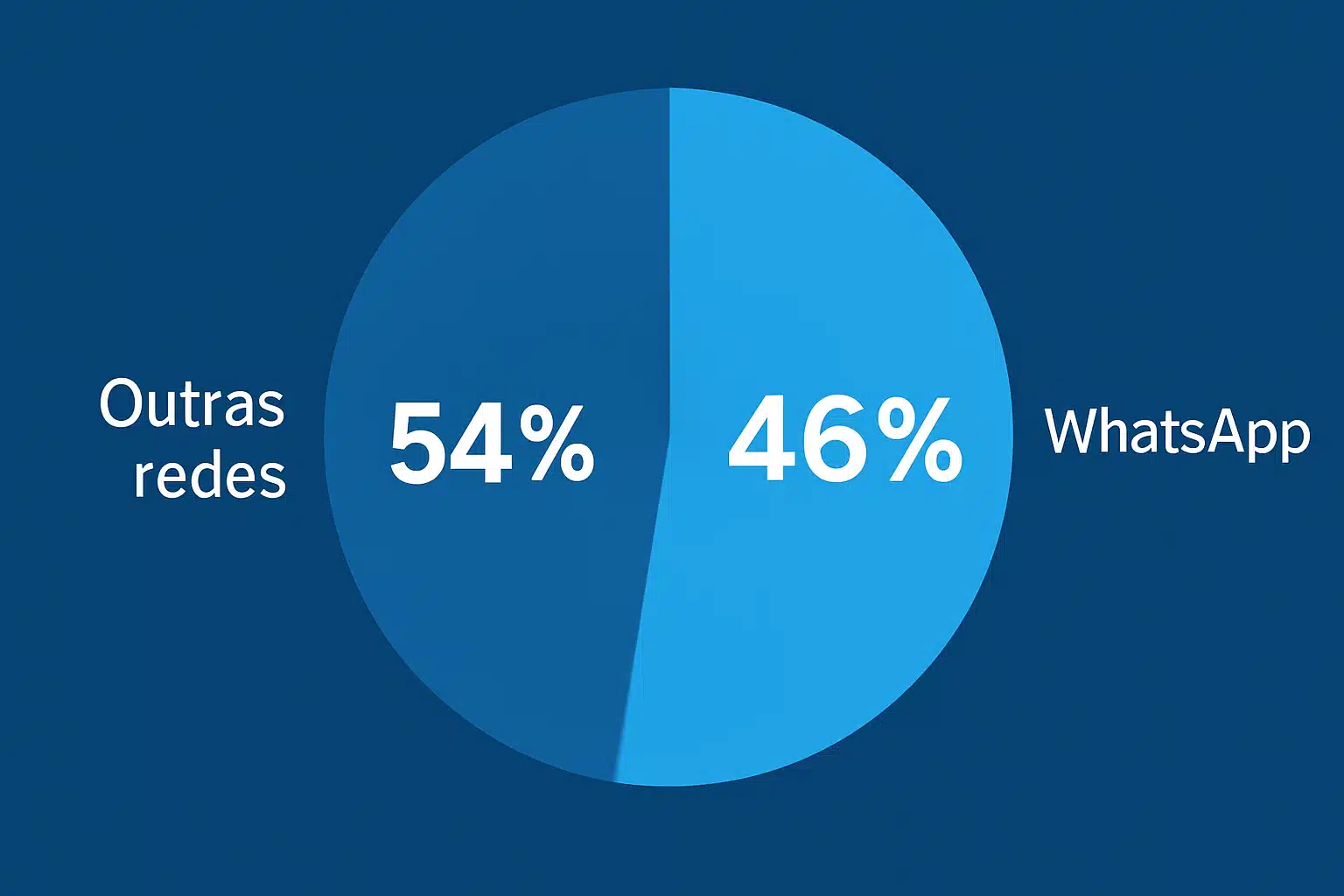

Uma mudança relevante é observada na dispersão das plataformas de circulação dessa desinformação. Se em 2024 o WhatsApp centralizava quase 90% das ocorrências, em 2025 essa participação caiu para 46%. Não significa menos fake news por lá, mas maior pulverização: redes como Facebook, Instagram, Threads, Kwai, Tiktok e X (antigo Twitter) se consolidaram como canais de amplificação.

Boas práticas e caminhos para se proteger

- Desconfie de vídeos e áudios sensacionalistas sobre figuras públicas, principalmente próximos a eleições ou decisões importantes;

- Busque múltiplas fontes antes de compartilhar supostas falas ou imagens impactantes;

- Acompanhe canais independentes de checagem e entenda como funcionam os métodos de verificação, como os praticados pelo Observatório Lupa;

- Ative recursos de verificação automática e atualize apps, pois redes sociais investem em ferramentas de identificação de IA.

Perguntas frequentes

- Qual o impacto do crescimento de conteúdos falsos 2026?

O aumento torna mais difícil identificar informações verdadeiras e enfraquece a confiança social, impactando debates eleitorais, decisões governamentais e o cotidiano das pessoas. - Por que os políticos são os principais alvos?

Lideranças políticas mobilizam opiniões e possuem grande exposição na mídia. Manipulações usando IA têm alto potencial de viralização, tornando-as alvos estratégico para disseminar desinformação. - Plataformas conseguem barrar 100% das fake news?

Não. Muitas empresas já utilizam IA e equipes de checagem, mas a velocidade de produção e disseminação supera a capacidade de remoção, exigindo ações combinadas com educação e regulamentação. - O que fazer se identificar um conteúdo falso criado por IA?

Evite compartilhar, reporte na plataforma e procure fontes de checagem antes de divulgar qualquer informação. O combate exige colaboração de usuários, empresas e entidades especializadas.

Continue acessando Portal Melhor Idade para mais conteúdos como este!

Debate sobre post